-

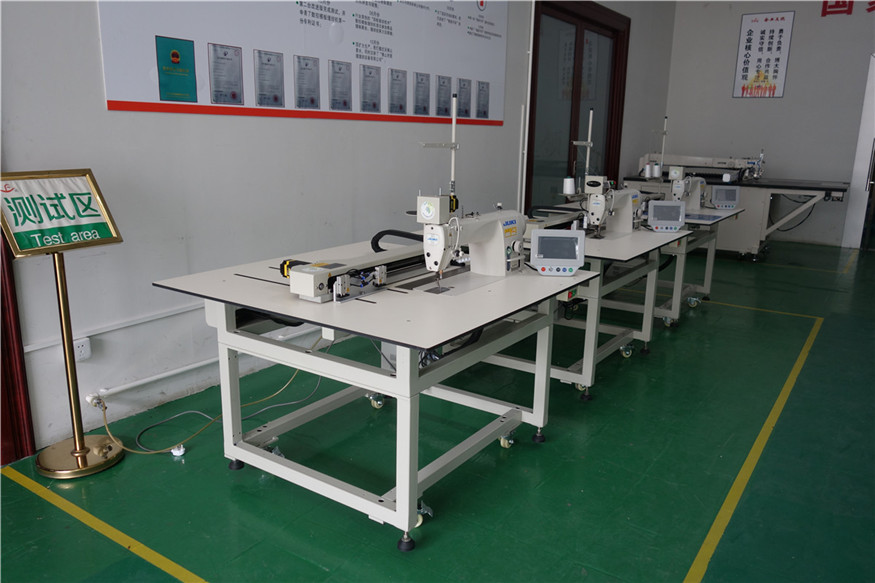

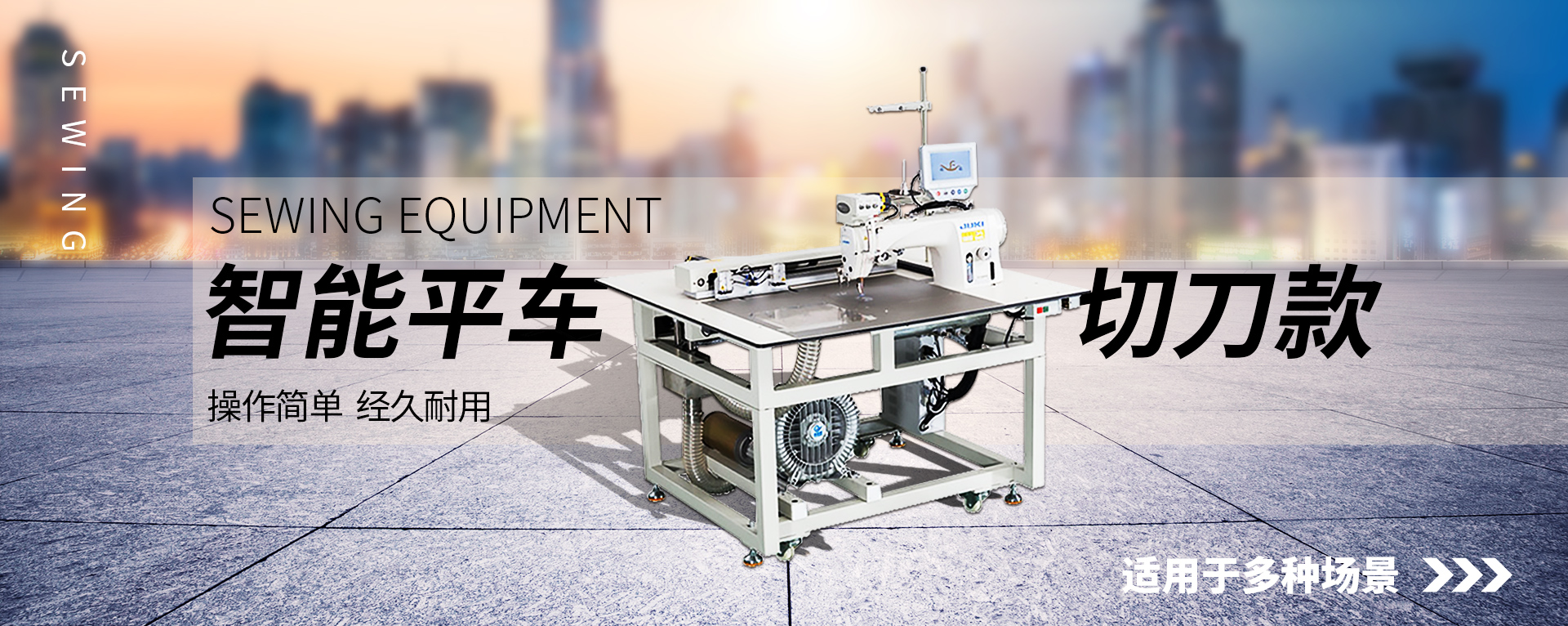

智能平車(chē)切刀款

產(chǎn)品特點(diǎn):

吸風(fēng)裝置

顯示屏

重機機頭

雙刀裝置

-

自動(dòng)開(kāi)門(mén)筒機

產(chǎn)品特點(diǎn):

吸風(fēng)裝置

顯示屏LOGO

重機機頭

雙刀裝置

-

自動(dòng)腳叉機

產(chǎn)品特點(diǎn):

精密車(chē)縫夾具

吸風(fēng)裝置

顯示屏LOGO

重機機頭

-

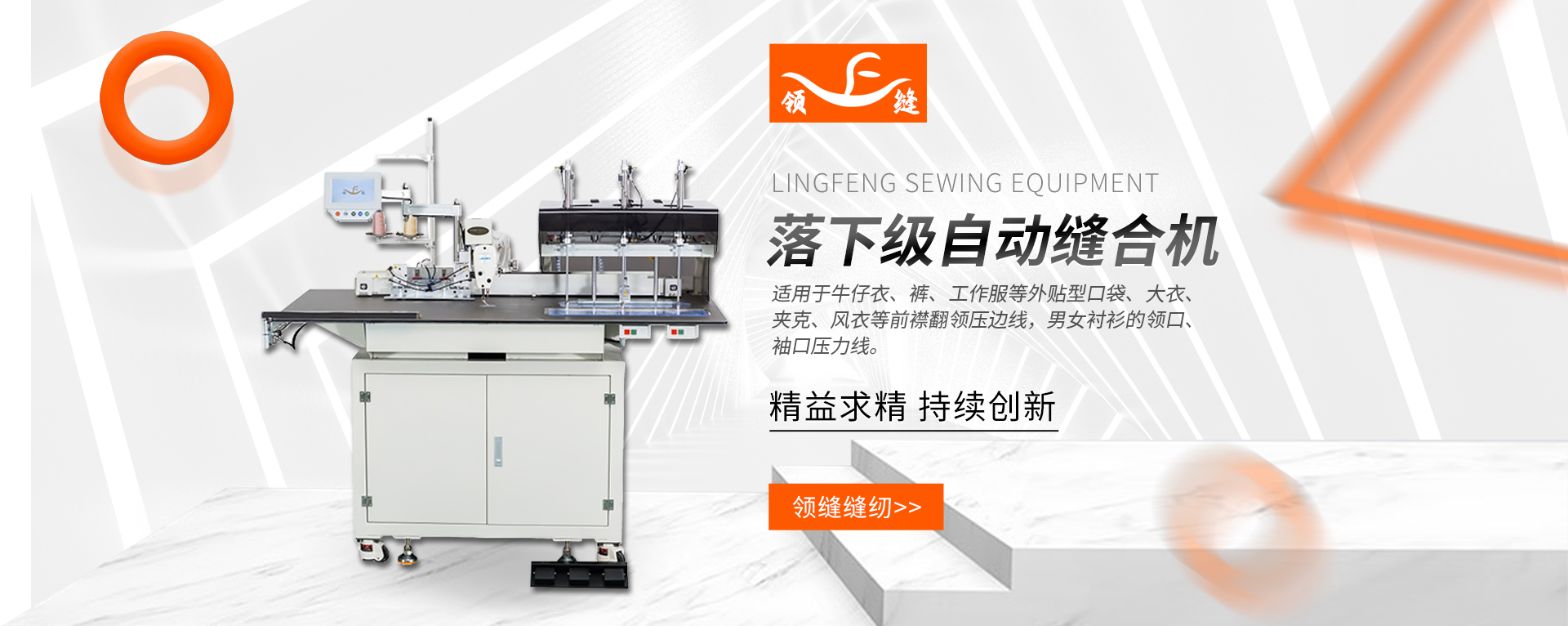

落下級自動(dòng)縫合機

產(chǎn)品特點(diǎn):

Xy軸精準定位

大范圍吸風(fēng)孔面板

顯示屏

重機機頭

-

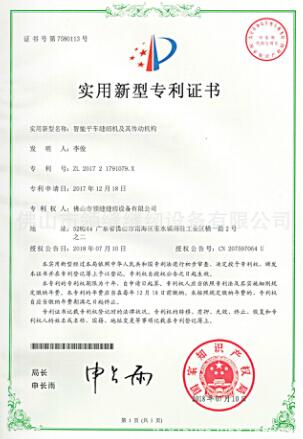

內衣電腦穿鋼圈機

產(chǎn)品特點(diǎn):

人工穿鋼圈

人工穿鋼圈

電腦穿鋼圈

自動(dòng)計件功能

-

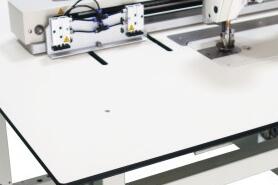

智能平車(chē)吸風(fēng)款

產(chǎn)品特點(diǎn):

不銹鋼吸風(fēng)口

吸風(fēng)裝置

顯示屏LOGO

重機機頭

-

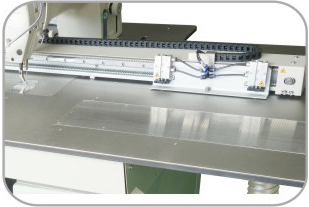

智能平車(chē)普通款

產(chǎn)品特點(diǎn):

重機機頭

Xy軸精準定位

加固加大面板設計

顯示屏

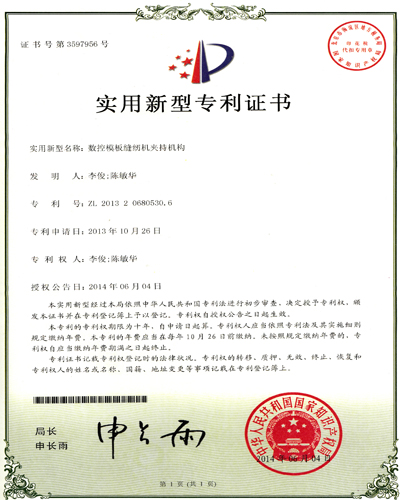

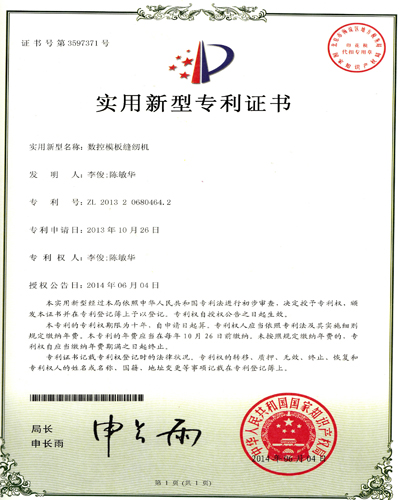

領(lǐng)縫產(chǎn)品展示

生產(chǎn)|研發(fā)|銷(xiāo)售|高新技術(shù)企業(yè)!您身邊的全自動(dòng)化設備專(zhuān)家!

縫

縫